Как узнать кадастровый номер земельного участка по координатам?

На территории Российской Федерации все земельные участки, считающееся объектом недвижимости, имеют свой уникальный собственный кадастровый номер.

Присваивается он во время проведения кадастрового учёта. Информация обо всех объектах недвижимости в целом и о земельных участках в частности находится в открытом доступе в интернете на портале Росреестра и на сайтах, предоставляющих посреднический доступ к его базе данных и публичной карте.

СодержаниеПоказать

Как найти кадастровый номер земельного участка по координатам онлайн?

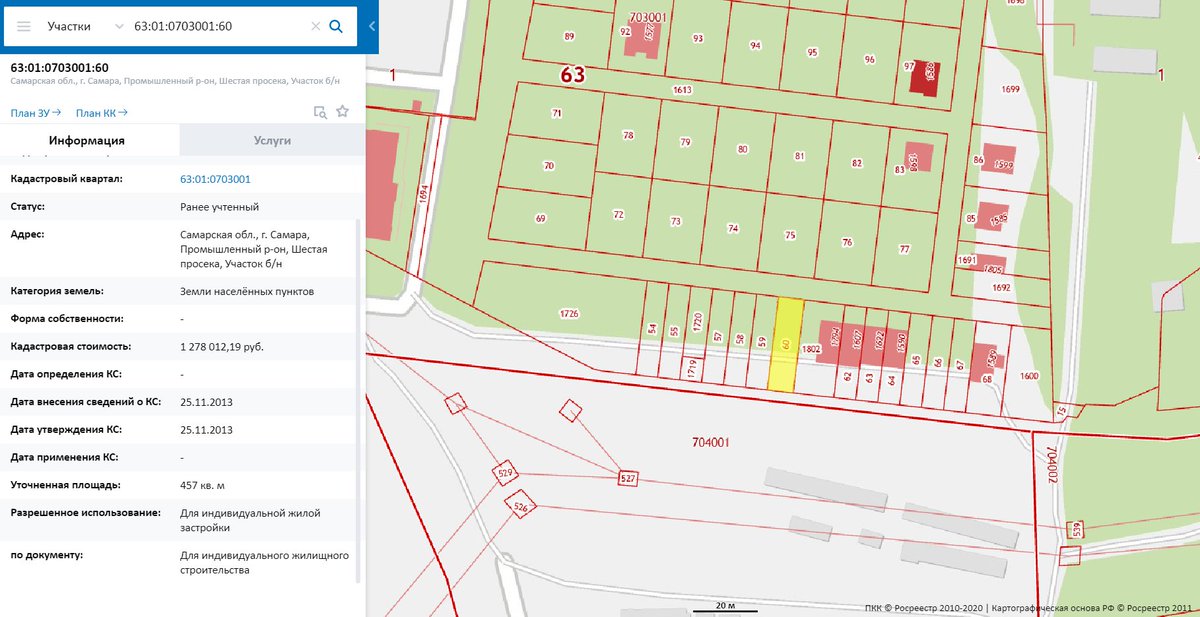

Если у вас имеются на руках координаты вашего земельного участка, то узнать с его помощью кадастровый номер объекта не составит труда. Для этого следует выполнить серию нижеследующих действий:

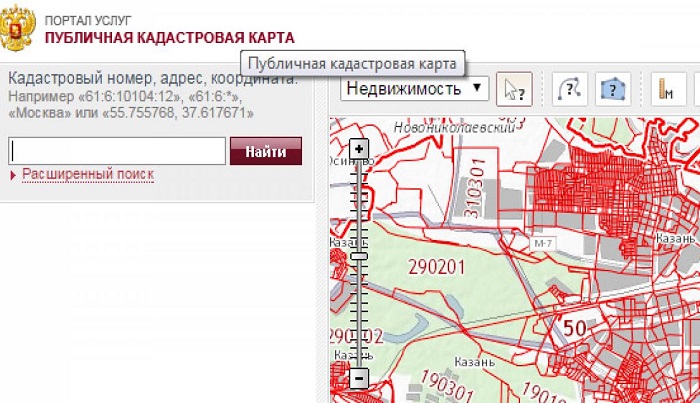

- Зайти на сайт Росреестра (для этого можно перейти по ссылке https://rosreestr.ru/).

- Пролистать ниже и найти ссылку, ведущую на публичную кадастровую карту (или сразу перейти по ссылке http://pkk5.

rosreestr.ru, минуя пункт 1)

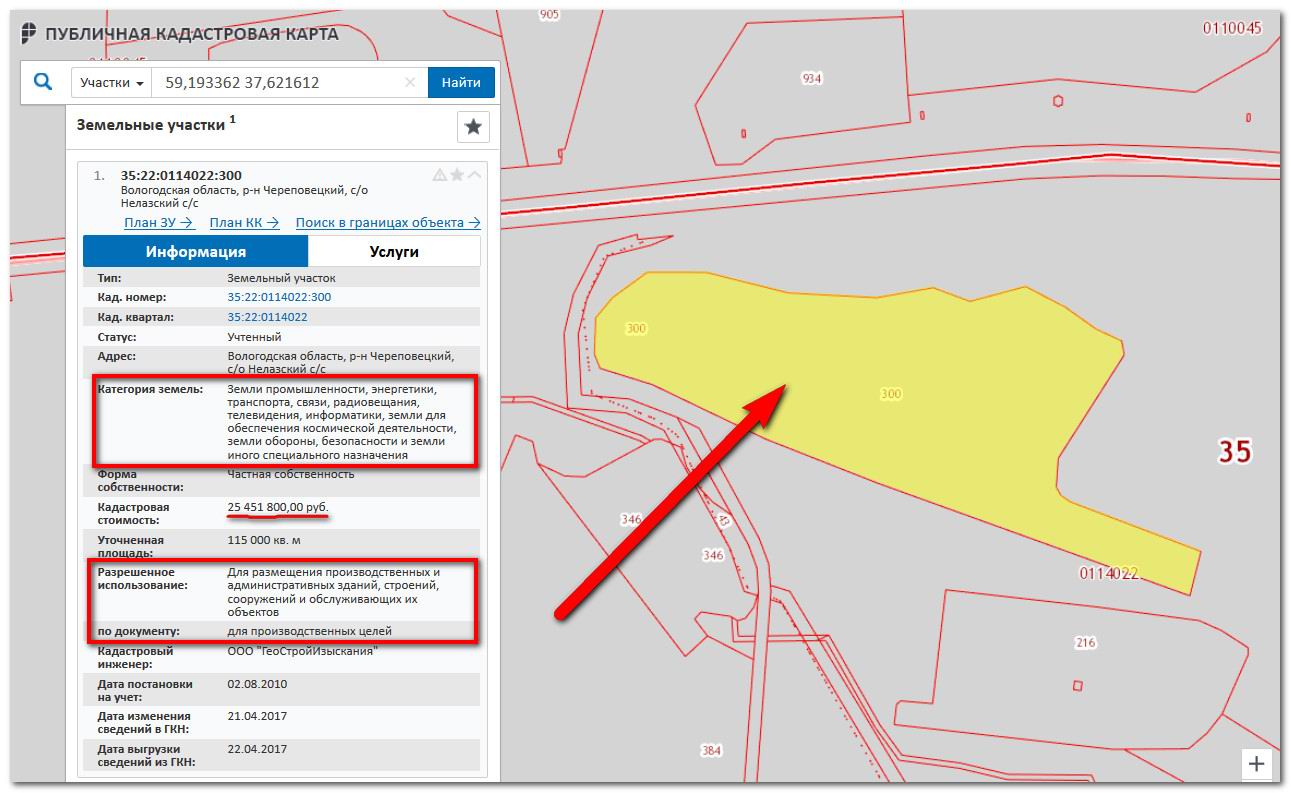

rosreestr.ru, минуя пункт 1) - По координатам отыскать на карте необходимый вам земельный участок (для этого можно либо ввести координаты в строку поиска, либо, если формат координат отличается от поддерживаемого публичной картой, воспользоваться другим сервисом, предоставляющим возможность поиска по координатам, и сопоставить информацию, полученную с его помощью, с картой).

- Кликнуть по земельному участку левой кнопкой мыши и во всплывающем окне посмотреть информацию по нему, включающую его кадастровый номер.

Что делать, если при помощи кадастровой карты сведения получить не удалось?

Если у вас не получилось найти интересующую вас информацию по участку, вы можете получить эти данные из Единого государственного реестра недвижимости (ЕГРН).Сделать это можно несколькими различными способами.

Электронная форма

Поскольку сведения из ЕГРН общедоступны, выписку оттуда вы можете получить через любой сторонний ресурс, специализирующийся на работе с ЕГРН.

В офисах Росреестра

Чтобы получить выписку напрямую из Росреестра, следует предварительно записаться в ближайшее отделение Росреестра на приём. Сделать это можно при помощи сервиса «Офисы и приёмные». Услуга эта бесплатна, а отслеживать статус своего заявления можно в режиме прямой связи по ссылке https://lk.rosreestr.ru/#/offices.

Во многофункциональных центрах

Точно так же можно получить документ и в любом МФЦ. Процедура подачи заявления идентична вышеописанной, вам следует лишь выбрать МФЦ вместо отделения Росреестра при выборе места для записи на приём.

Ставка земельного налога для юридических лиц, как правило, выше чем для физических.В некоторых случаях право собственности на земельный участок можно признать только через суд. Как это сделать, вы можете узнать из нашей статьи.

Инвалиды с детства и инвалиды 1 и 2 группы имеют определенные льготы по земельному налогу. Подробнее об этом мы рассказали здесь.

Подробнее об этом мы рассказали здесь.

Выездное обслуживание

Если у вас нет возможность явиться в отделение или МФЦ самостоятельно, вы можете воспользоваться услугами выезда сотрудников Росреестра и доставки интересующих вас документов.Стоимость этих услуг следует заранее уточнить. Сделать это можно по телефону центра обслуживания Росреестра, указанному на портале, посредством отправки бумажного или электронного письма, а также в офисах и отделениях Росреестра.

Почтовым отправлением

Есть также возможность послать запрос в территориальное отделение Росреестра почтовым отправлением. На сайте Росреестра для этого необходимо найти раздел «Территориальная сеть», где можно найти адрес ближайшего к вам такого отделения.

Не нашли ответа на свой вопрос? Звоните на телефон горячей линии8 (800) 350-34-85. Это бесплатно.

Юрист. Практика в сфере недвижимости, тудового права, семейного права, защите прав потребителей

по кадастровому номеру, поиск по адресу земли, или визуально на публичном сервисе Росреестра

Все объекты недвижимости в нашей стране заносятся в единый реестр, который сокращённо называется ЕГРН (единый государственный реестр недвижимости).

Официальным ресурсом его является публичная кадастровая карта России.

На неё нанесены все объекты, границы которых поставлены на кадастровый учёт.

Поскольку процесс постановки на кадастровый учёт происходит непрерывно, данные на карте постоянно дополняются и расширяются.

А старые сведения могут потерять свою актуальность.

Например, в случае разделения участка на два новых сведения о предыдущем объекте будут отправлены в архив.

Зайти на публичную кадастровую карту можно с официального сайта Росреестра: http://pkk5. rosreestr.ru

rosreestr.ru

И если необходимо найти актуальную на сегодняшний день информацию об объекте недвижимости, в частности на земельные участки:

- размер,

- форму,

- местоположение и т.д.,

на карте вы сможете обнаружить большинство из них.

Способы поиска данных на публичной карте

Существеут несколько способов найти нужную информацию при помощи публичной кадастровой карты Росреестра.

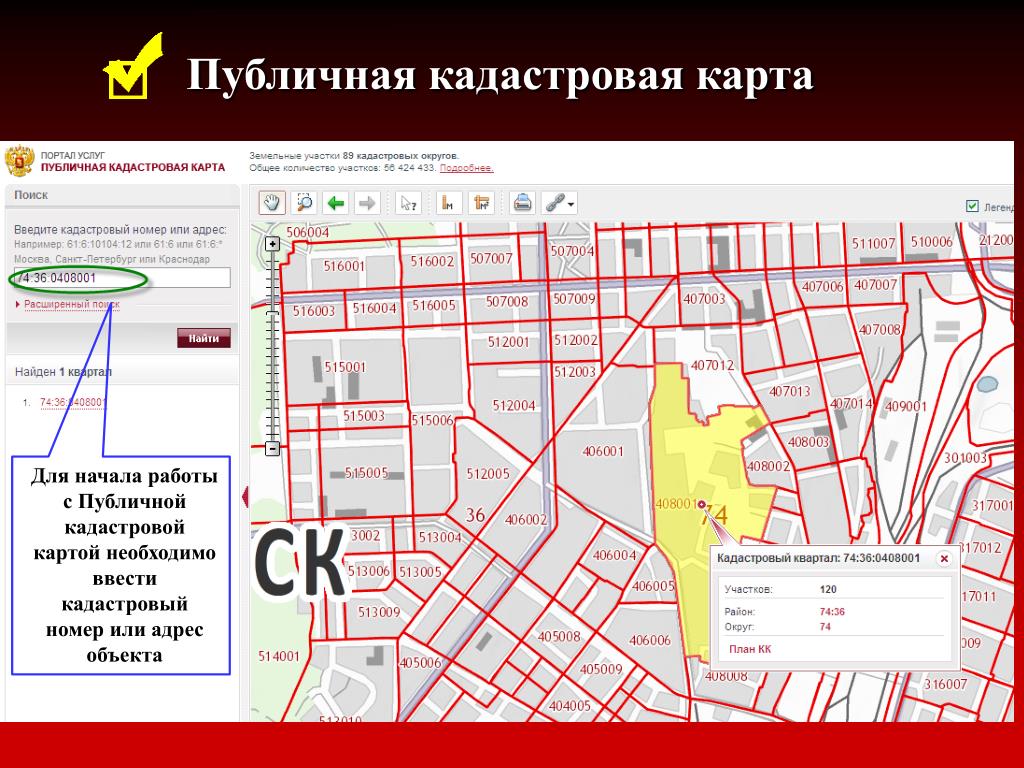

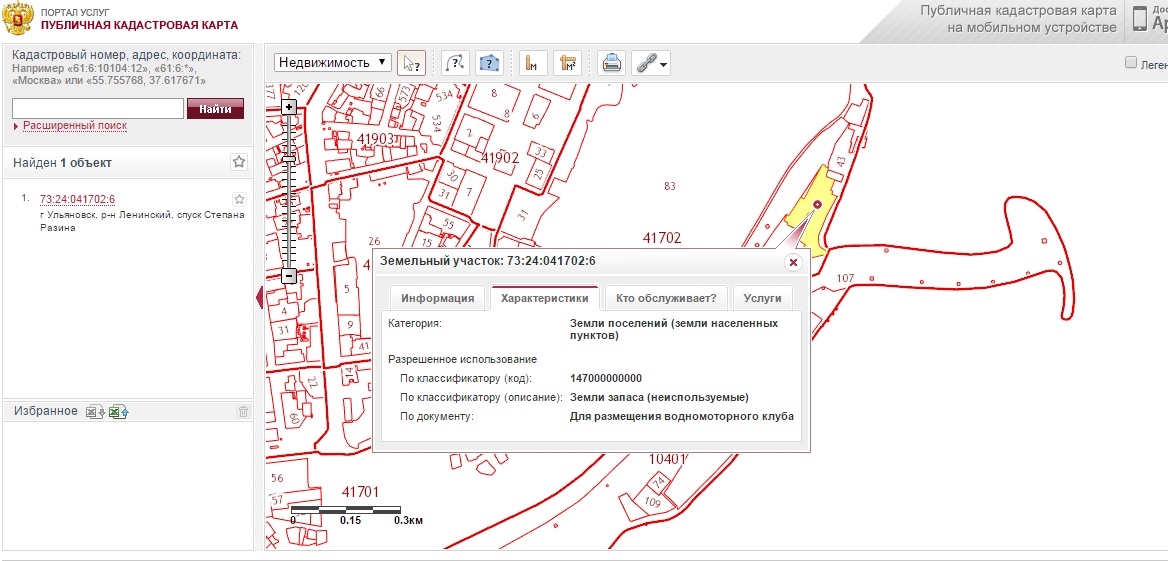

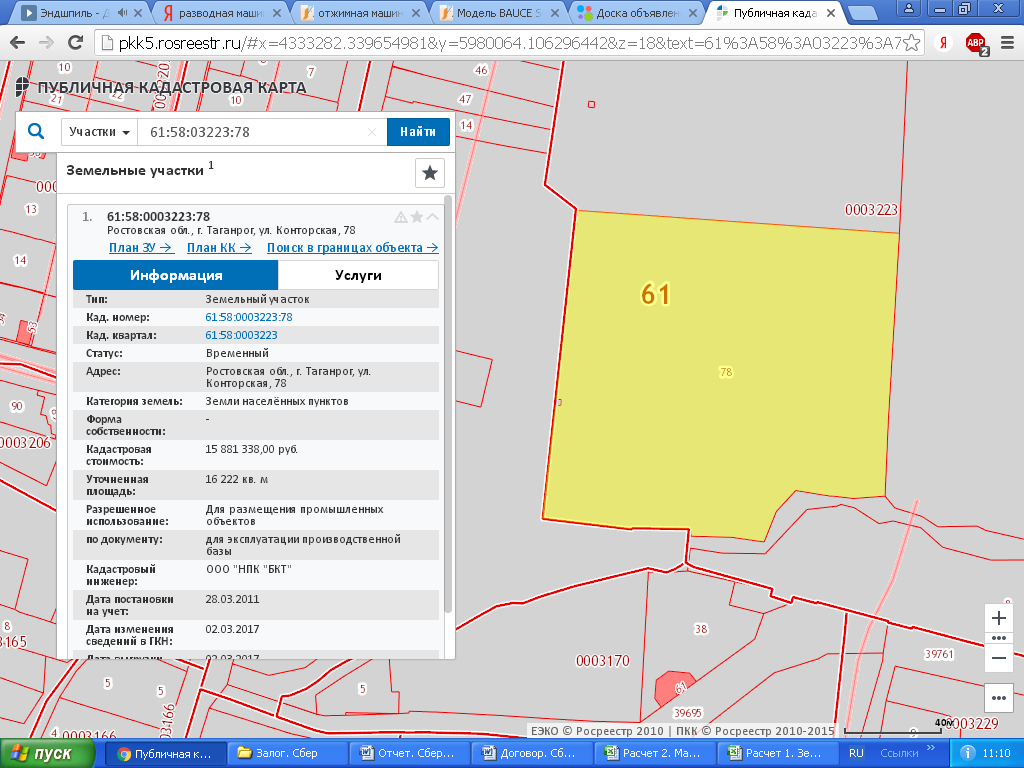

По кадастровому номеру

Когда вас интересует определённый земельный участок, свой или чужой, и вы знаете его кадастровый номер, то узнать о нём более подробную информацию будет достаточно легко.

Откройте сайт публичной кадастровой карты. На нём в столбике со знаками в левом верхнем углу экрана надо найти и нажать на изображение лупы. Выпадает поисковое окно, в которое вписывают номер участка и затем нажимают «Найти».

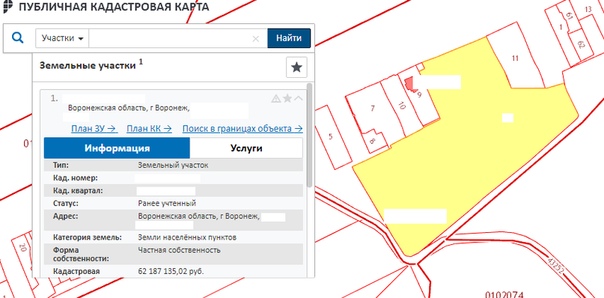

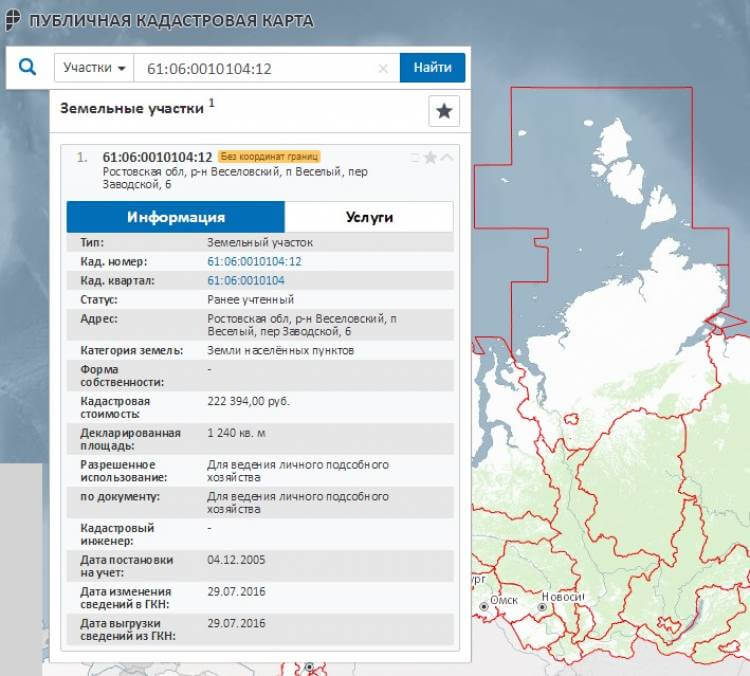

Если границы участка стоят на кадастровом учёте, он буквально сразу же высвечивается на экране. И вы увидите место его форму и точное место расположения. При этом в окне в левой верхней части экрана появятся набор характеристик данного объекта.

При этом в окне в левой верхней части экрана появятся набор характеристик данного объекта.

Чаще всего людей интересует:

Даже когда границы не стоят на учёте, но присвоен кадастровый номер, у вас высветится информация об этом объекте в левом окне, однако на самой карте он будет отсутствовать.

По адресу земли

Ресурс позволяет находить участок и по почтовому адресу. В том же диалоговом окне рядом с лупой расположено окошко меньшего размера, в котором по умолчанию написано «Участки».

Нажимаете в нём на треугольник и в выпавшем списке ищете слово «Адреса». Дальше можете вписывать в строке поиска адрес искомого участка.

Однако такой способ часто даёт сбои, особенно когда искомый объект расположен в сельской местности. Названия небольших населённых пунктов и улиц часто дублируются, и в результате поиск может завести совершенно не в тот район. И тогда приходится разыскивать участок вручную.

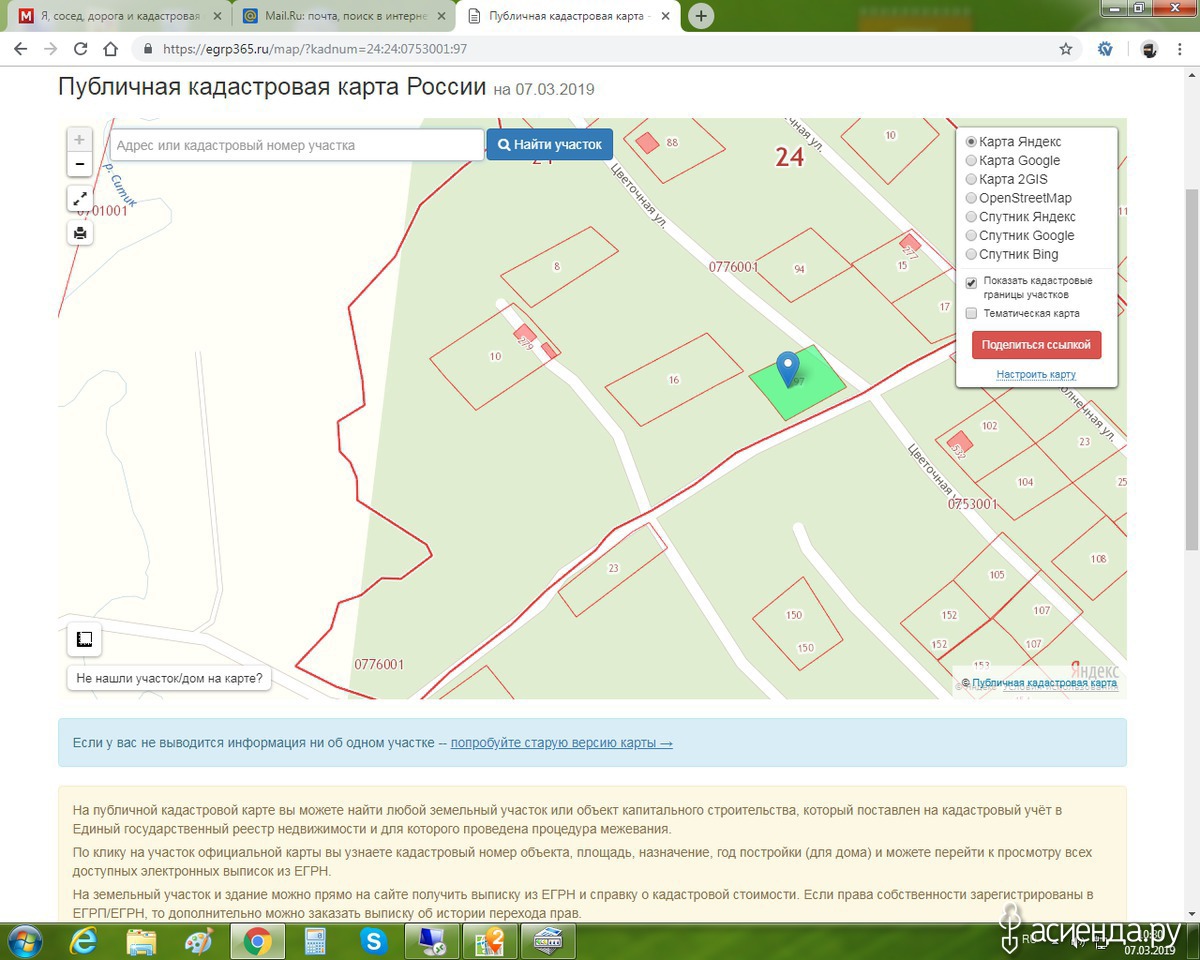

Поиск своими руками

Для этого стоит воспользоваться регулировкой масштаба карты, расположенной в правом нижнем углу экрана.

Зная регион, где располагается земельный участок, наведите курсор мышки на эту область и начинайте постепенно увеличивать масштаб.

При крупном увеличении сначала появятся границы области и районов. Найдите нужный вам населённый пункт и продолжайте увеличивать масштаб уже непосредственно в нужном вам месте.

При ближайшем рассмотрении хорошо видна конфигурация участка и расположение поставленных на учёт строений. И тут всё зависит от вашей ассоциативной памяти.

Если вы хорошо знаете, что расположено рядом с искомым участком на местности, то сможете быстро определить его местоположение на карте.

После этого нажмите на его изображение, и моментально в левом верхнем углу появится вся доступная о нём информация, включая адресую часть и кадастровый номер. Таким образом при помощи поиска вручную по карте можно найти не только интересующий вас участок, но и определить его кадастровый номер и прочие данные.

Для удобства поиска можно включить космический снимок местности. Для этого в левом столбце находите значок управления картой. Он похож на стопку бумаг.

На фото он расположен сверху:

Нажимаете на него и в выпавшем диалоговом окне ставите галочку рядом с надписью «Космические снимки». Это поможет вам быстрее сориентироваться. Подробнее о поиске по спутнику читайте в отдельной статье.

Кроме того, в окошке информации о земельном участке можно сразу же перейти и узнать о нём сведения ЕГРН. Нажмите на «Услуги».

И здесь выбираете в каком виде хотите их получить: в форме официальной выписки из ЕГРН или бесплатной справочной в режиме онлайн, позволяющей узнать о существовании ограничений в правах на объект.

Полезное видео

Смотрите интересный видеоматериал, в котором рассказывается, как осуществлять поиск земельного участка на публичной кадастровой карте.

Заключение

Умение хорошо работать с публичной кадастровой картой является необходимым для кадастровых инженеров, риелторов, юристов.

Простым обывателей этот навык может пригодится во время поиска и покупки земельного участка. Так они сразу смогут получить достоверную информацию, которая пригодится им для принятия решения о покупке того или иного надела.

Разработчики ресурса постарались сделать его максимально удобным и понятным пользователям. Собственники земли могут, например, использовать его для уточнения актуальной кадастровой стоимости своего участка, с которой начисляется земельный налог и много другой полезной информации.

Вконтакте

Одноклассники

Мой мир

Узнать адрес по кадастровому номеру объекта онлайн бесплатно

Узнать адрес недвижимости по кадастровому номеру онлайн несложно. Достаточно выбрать сайт, ввести в поисковую строку код и система выдаст адрес интересующего объекта. Кроме этого, с помощью этих сведений можно узнать и многое другое.

Информация в кадастровом номере

Чтобы узнать адрес собственника по кадастровому номеру, не нужно, как раньше ходить по разных учреждениям в поиске нужной информации. В век цифровых технологий все можно сделать через интернет.

В век цифровых технологий все можно сделать через интернет.

Почему можно использовать для получения нужной информации этот индивидуальный шифр? В нем содержатся данные о:

- присвоении права собственности на объект имущества;

- округе в России;

- районе – в основном он совпадает с региональным делением;

- квартале.

Где узнать адрес по кадастровому номеру

Если требуется найти адрес по кадастровому номеру земельного участка, мы рекомендуем воспользоваться нашим сайтом. мы гарантируем каждому пользователю:

- оперативную обработку запроса – ответ придет через несколько минут при условии, что Росреестр работает без перебоя;

- актуальность данных – они предоставляются на момент обращения пользователя;

- официальную информацию из Росреестра – все данные об объекте недвижимости предоставляются согласно требованию законодательства;

- доступную оплату за пользование сервисом;

- удобный поиск;

- точность результата.

Кадастровый номер земельного участка в РБ — проверить, узнать по адресу

Кадастровый номер земельного участка – это уникальное сочетание чисел, представляющее собой идентификационный номер определенного земельного надела на территории Беларуси. У каждого участка – свой кадастровый номер, который он получает во время учета государственных земель.

Система кадастрового учета необходима для наиболее эффективного использования государственной территории. Порядок помогает при распределении земель, назначении функций территорий, защите экологически-важных площадок, продаже вакантных участков и избегания нелегальных сделок на рынке недвижимости. Стоит отметить, что кадастровые номера присваиваются не только земельным участкам, но и иным объектам недвижимого имущества, расположенным на территории страны.

Как присваивается кадастровый номер участка

Кадастровый номер участка – не случайный набор цифр, закодированная форма несет определенные данные об объекте, его месторасположении и регистрации в общей системе. В 18-значном номере зашифрован код административно-территориальной единицы, кадастровый блок и личный номер участка.

Как узнать кадастровый номер земельного участка

Учетам государственных земель и присваиванию участкам кадастровых номеров занимаются специалисты ГУП «Национальное кадастровое агентство». На официальном сайте структуры можно получить необходимую информацию о работе кадастрового агентства, а также данные о кадастровой стоимости зарегистрированного и незарегистрированного земельного участка; уникальный идентификатор объекта; даты внесения и аннулирования записей об объекте и многое другое.

Узнать кадастровый номер зарегистрированного земельного участка можно и самостоятельно, если вы знаете адрес или можете найти объект на карте. В помощь — публичная кадастровая карта Республики Беларусь. Наводите на нужный участок – и видите кадастровый номер интересующего земельного надела. Важно, чтобы в настройках были выделены правильные графы.

В помощь — публичная кадастровая карта Республики Беларусь. Наводите на нужный участок – и видите кадастровый номер интересующего земельного надела. Важно, чтобы в настройках были выделены правильные графы.

Если вас интересует кадастровая стоимость или налоговая база земельного участка, то стоит прибегнуть к этой карте. Онлайн ресурс позволяет в считанные минуты и совершенно бесплатно, узнать всю необходимую информацию о стоимости, функциях, площади, дате регистрации и границах зарегистрированного земельного участка. Для этого вам необходимо знать лишь адрес или кадастровый номер объекта.

Кадастровая стоимость земель используется для определений стартовых ставок на земельных торгах; при продаже, предоставлении, выкупе, аренды или оценки участков; для формирования ипотечных взносов, градостроительного планирования и иных сделок с объектами недвижимого имущества.

Как правило, кадастровая стоимость участков отличается в зависимости от месторасположения. Это наиболее важный критерий при определении цены.

Это наиболее важный критерий при определении цены.

Важно понимать, что кадастровая стоимость отражает срез цен на определенную дату, когда была произведена оценка. Наиболее точную и актуальную информацию даст рыночная цена объекта. Более подробную информацию можно прочитать в материале Realt.by.

Поиск по адресному регистру РК: кадастровый номер, код РКА

Адресный регистр РК представляет собой единый реестр адресов объектов недвижимости на территории Республики Казахстан, включая административно-территориальные объекты от областей и городов до номеров домов и квартир. Данный сервис предоставляет возможность поиска кадастровых номеров и кодов РКА земельных участков, домов, квартир, нежилых помещений и прочего с помощью древовидной иерархической структуры.

Кадастровый номер и код РКА — уникальные, не повторяющийся на территории Республики Казахстан, номера, присваиваемые информационной системой Адресный регистр (код АР) Министерства информации и коммуникаций Республики Казахстан (http://mic.

Поиск по кадастровому номеру или РКА:

Поиск по древовидной структуре

Начните раскрывать структуру кликами по стрелкам слева от региона

| ИС Адресный регистр |

|---|

| НУР-СУЛТАН город республиканского значения РКО: 0003000000008716 |

| ШЫМКЕНТ город республиканского значения РКО: 0003000000008664 |

| АЛМАТЫ город республиканского значения |

| АКТЮБИНСКАЯ область РКО: 0003000000008686 |

| АЛМАТИНСКАЯ область РКО: 0003000000008687 |

| АТЫРАУСКАЯ область РКО: 0003000000008683 |

| ЗАПАДНО-КАЗАХСТАНСКАЯ область РКО: 0003000000008685 |

| КАРАГАНДИНСКАЯ область РКО: 0003000000008695 |

| КОСТАНАЙСКАЯ область РКО: 0003000000008690 |

| КЫЗЫЛОРДИНСКАЯ область РКО: 0003000000008692 |

| МАНГИСТАУСКАЯ область РКО: 0003000000008688 |

| ПАВЛОДАРСКАЯ область РКО: 0003000000008682 |

| СЕВЕРО-КАЗАХСТАНСКАЯ область РКО: 0003000000008689 |

| АКМОЛИНСКАЯ область РКО: 0003000000008691 |

| ВОСТОЧНО-КАЗАХСТАНСКАЯ область РКО: 0003000000008684 |

Array. prototype.map () — JavaScript | MDN

prototype.map () — JavaScript | MDN

Метод map () создает

новый массив , заполненный результатами вызова предоставленной функции на

каждый элемент в вызывающем массиве.

Исходный код этого интерактивного примера хранится в репозитории GitHub. Если вы хотите внести свой вклад в проект интерактивных примеров, клонируйте https://github.com/mdn/interactive-examples и отправьте нам запрос на перенос.

Исходный код этого интерактивного примера хранится в GitHub. репозиторий.Если вы хотите внести свой вклад в проект интерактивных примеров, пожалуйста, клонировать https://github.com/mdn/interactive-examples и отправьте нам запрос на перенос. let newArray = arr.map (callback (currentValue [, index [, array]]) {

} [, thisArg]);

Параметры

-

обратный звонок Функция, которая вызывается для каждого элемента

arr. Каждый раз

Каждый раз обратный вызоввыполняется, возвращенное значение добавляется кновый массив.Функция обратного вызова

-

текущее значение - Текущий обрабатываемый элемент в массиве.

-

индексДополнительно - Индекс текущего обрабатываемого элемента в массиве.

-

массивДополнительно - Была вызвана карта массива

-

-

thisArgДополнительно - Значение, которое будет использоваться как

Возвращаемое значение

Новый массив, каждый элемент которого является результатом функции обратного вызова.

карта вызывает предоставленную функцию обратный вызов один раз для каждого элемента в массиве по порядку и создает новый массив

от результатов.

обратный вызов вызывается только для индексов

массив, которому присвоены значения (включая undefined ).

Это , а не , вызванный отсутствующими элементами массива; то есть:

- индексов, которые никогда не устанавливались;

- индексов, которые были удалены.

Когда не использовать map ()

Начиная с , map строит новый массив, используя его, когда вы не используете возвращенный

массив — антипаттерн; используйте для каждого или вместо ... из .

Вы не должны использовать карту , если:

- вы не используете возвращаемый массив; и / или

- , вы не возвращаете значение из обратного вызова.

Подробные сведения о параметрах

обратный вызов вызывается с тремя аргументами: значением

element, индекс элемента и отображаемый объект массива.

Если указан параметр thisArg , он будет использоваться как обратный вызов это значение . В противном случае значение

В противном случае значение undefined будет использоваться как

его это значение . - это значение , которое в конечном итоге может наблюдать обратный звонок определяется по обычным правилам для

определение

карта не изменяет массив, в котором она вызывается (хотя обратный вызов , если вызывается, может это сделать).

Диапазон элементов, обрабатываемых картой устанавливается перед первым вызовом

из обратный звонок . Элементы, которые добавляются к массиву после

звонок на карта начинается не будут посещены обратный звонок .

Если существующие элементы массива изменились после вызова map , их

value будет значением в то время, когда обратный вызов посещает их.Элементы, которые удаляются после вызова , карта начинается и до того, как

посещенные не посещаются.

Из-за алгоритма, определенного в спецификации, если массив, который отображает был вызван является разреженным, результирующий массив также будет разреженным, сохраняя те же индексы

пустой.

карта была добавлена в стандарт ECMA-262 в 5-м издании. Следовательно, это

может присутствовать не во всех реализациях стандарта.

Вы можете обойти это, вставив следующий код в начало вашего

скрипты, позволяющие использовать карту в реализациях, которые изначально не

поддержите это.Этот алгоритм в точности тот, что указан в ECMA-262, 5-е издание,

предполагая, что Object , TypeError и Array имеют

их исходные значения и что callback.call оценивается как исходный

значение . Function.prototype.call

if (! Array.prototype.map) {

Array.prototype.map = function (callback) {

var T, A, k;

if (this == null) {

throw new TypeError ('это null или не определено');

}

var O = объект (это);

var len = O. длина >>> 0;

if (typeof callback! == 'функция') {

выбросить новый TypeError (callback + 'не является функцией');

}

if (arguments.length> 1) {

T = аргументы [1];

}

A = новый массив (len);

k = 0;

while (k

длина >>> 0;

if (typeof callback! == 'функция') {

выбросить новый TypeError (callback + 'не является функцией');

}

if (arguments.length> 1) {

T = аргументы [1];

}

A = новый массив (len);

k = 0;

while (k Отображение массива чисел в массив квадратных корней

Следующий код принимает массив чисел и создает новый массив, содержащий квадратные корни чисел в первом массиве.

пусть числа = [1, 4, 9]

пусть корни = числа. карта (функция (число) {

вернуть Math.sqrt (число)

})

карта (функция (число) {

вернуть Math.sqrt (число)

})

Использование карты для переформатирования объектов в array

Следующий код принимает массив объектов и создает новый массив, содержащий недавно отформатированные объекты.

let kvArray = [{ключ: 1, значение: 10},

{ключ: 2, значение: 20},

{ключ: 3, значение: 30}]

let переформатироватьArray = kvArray.map (obj => {

пусть rObj = {}

rObj [объект.ключ] = obj.value

вернуть rObj

})

Сопоставление массив чисел с использованием функции, содержащей аргумент

Следующий код показывает, как map работает, когда функция, требующая одного

с ним используется аргумент. Аргумент будет автоматически назначен из каждого элемента

массива как карта проходит через исходный массив.

пусть числа = [1, 4, 9]

let doubles = numbers.map (function (num) {

вернуть число * 2

})

Общее использование карты

В этом примере показано, как использовать карту в строке для получения массива байтов в

кодировка ASCII, представляющая значения символов:

let map = Array. prototype.map

let a = map.call ('Hello World', function (x) {

вернуть x.charCodeAt (0)

})

prototype.map

let a = map.call ('Hello World', function (x) {

вернуть x.charCodeAt (0)

})

Общее использование карты querySelectorAll

В этом примере показано, как перебирать коллекцию объектов, собранных querySelectorAll . Это потому, что querySelectorAll возвращает NodeList (который представляет собой набор объектов).

В этом случае мы возвращаем все выбранные значения option s на экране:

пусть elems = document.querySelectorAll ('вариант выбора: установлен')

let values = Array.prototype.map.call (elems, function (obj) {

вернуть obj.value

})

Более простой способ - это метод Array.from () .

Сложный вариант использования

(на основе этого сообщения в блоге)

Обычно обратный вызов используется с одним аргументом (просматриваемый элемент).

Некоторые функции также обычно используются с одним аргументом, даже если они принимают

дополнительные необязательные аргументы. Эти привычки могут привести к путанице в поведении.

Эти привычки могут привести к путанице в поведении.

Рассмотрим:

["1", "2", "3"]. Map (parseInt) Хотя можно было ожидать [1, 2, 3] , фактический результат [1, NaN, NaN] .

parseInt часто используется с одним аргументом, но принимает два. Первый - это

выражение, а второе - основание функции обратного вызова, Array.prototype.map передает 3 аргумента:

- элемент

- индекс

- массив

Третий аргумент игнорируется parseInt - но не второй

один! Это источник возможной путаницы.

Вот краткий пример шагов итерации:

parseInt ("1", 0)

parseInt ("2"; 1)

parseInt ("3"; 2)

Тогда поговорим о решениях.

function returnInt (element) {

вернуть parseInt (элемент, 10)

}

['1', '2', '3']. Map (returnInt);

['1', '2', '3']. Map (str => parseInt (str))

['1', '2', '3']. Map (Число)

['1.1', '2.2e2', '3e300']. Map (Число)

['1.1', '2.2e2', '3e300']. Map (str

Map (Число)

['1.1', '2.2e2', '3e300']. Map (Число)

['1.1', '2.2e2', '3e300']. Map (str Карта - JavaScript | MDN

Объект Map содержит ключ-значение

пар и запоминает исходный порядок вставки ключей.Любое значение (оба

объекты и примитивные значения) может использоваться как ключ

или значение.

Объект Map выполняет итерацию своих элементов в порядке вставки - a for ... of цикл возвращает массив [ ключ , значение ] для каждой итерации.

Равенство ключей

- Равенство ключей основано на

sameValueZeroалгоритм. -

NaNсчитается таким же, какNaN(хотяNaN! == NaN), а все остальные значения считаются равными в соответствии с семантика оператора===. - В текущей спецификации ECMAScript

-0и+0являются считается равным, хотя в более ранних проектах этого не было. См. "Равенство значений

для -0 и 0 " в браузере совместимость

таблица для деталей.

См. "Равенство значений

для -0 и 0 " в браузере совместимость

таблица для деталей.

Объекты и карты

Объект похож на Карта - оба позволяют устанавливать ключи к значениям,

получить эти значения, удалить ключи и определить, хранится ли что-то в ключе. За

по этой причине (и потому что не было встроенных альтернатив), Объект исторически использовался как карта .

Однако есть важные отличия, которые делают карту предпочтительной в

определенные случаи:

| Карта | Объект | |

|---|---|---|

| Случайные ключи | A Карта по умолчанию не содержит ключей. Он содержит только то, что

явно помещается в него. | Объект |

| Типы ключей | Клавиши A Map могут иметь любое значение (включая функции, объекты или любые

примитивный). | Ключи объекта должны быть либо строкой , либо Символ . |

| Ключ Заказ | Ключи на карте | Хотя ключи от обыкновенного Порядок был впервые определен для собственных свойств только в ECMAScript 2015;

ECMAScript 2020 также определяет порядок унаследованных свойств. См. OrdinaryOwnPropertyKeys

и EnumerateObjectProperties

абстрактные операции спецификации. |

Размер | Количество элементов на Карте легко получить из ее размер недвижимость. | Количество элементов в Объекте необходимо определять вручную. |

| Итерация | A Карта is |

Краткое руководство по обнаружению объектов глубокого обучения

Сегодняшний пост в блоге вдохновлен читателем PyImageSearch Иезекиилем, который на прошлой неделе написал мне по электронной почте и спросил:

Привет, Адриан,

Я просмотрел вашу предыдущую запись в блоге об обнаружении объектов глубокого обучения вместе с

с последующим руководством по обнаружению объектов глубокого обучения в реальном времени.Спасибо за это.

Я использовал ваш исходный код в своих примерах проектов, но у меня две проблемы:

- Как мне отфильтровать / игнорировать классы, которые меня не интересуют?

- Как мне добавить новые классы в детектор объектов? Это вообще возможно?

Я был бы очень признателен, если бы вы осветили это в своем блоге.

Спасибо.

Иезекииль - не единственный, кто задает эти вопросы. Фактически, если вы просмотрите раздел комментариев к двум моим последним сообщениям об обнаружении объектов глубокого обучения (ссылка приведена выше), вы обнаружите, что один из наиболее распространенных вопросов обычно (перефразированный):

Как мне изменить исходный код, чтобы включить в него мои собственные классы объектов?

Поскольку это, кажется, очень распространенный вопрос, а в конечном итоге является непониманием того, как на самом деле работают нейронные сети / детекторы объектов глубокого обучения , я решил вернуться к теме обнаружения объектов глубокого обучения в сегодняшнем сообщении в блоге.

В частности, из этого поста вы узнаете:

- Различия между классификацией изображений и обнаружением объектов

- Компоненты детектора объектов глубокого обучения , включая различия между платформой обнаружения объектов n и самой базовой моделью

- Как выполнить обнаружение объектов глубокого обучения с помощью предварительно обученной модели

- Как можно фильтровать и игнорировать предсказанные классы из модели глубокого обучения

- Распространенные заблуждения и недопонимания при добавлении или удалении классов из глубокой нейронной сети

Чтобы узнать больше об обнаружении объектов глубокого обучения и, возможно, даже развенчать несколько заблуждений или недоразумений, которые могут возникнуть при обнаружении объектов на основе глубокого обучения, просто продолжайте читать.

Краткое руководство по обнаружению объектов глубокого обучения

Сегодняшняя запись в блоге предназначена для мягкого введения в обнаружение объектов на основе глубокого обучения.

Я приложил все усилия, чтобы предоставить обзор компонентов детекторов объектов глубокого обучения, включая исходный код OpenCV + Python для выполнения глубокого обучения с использованием предварительно обученного детектора объектов.

Используйте это руководство, чтобы помочь вам начать работу с обнаружением объектов глубокого обучения, но также понять, что обнаружение объектов очень детализировано и детализировано. - Я не мог бы включить каждую деталь обнаружения объектов глубокого обучения в отдельную запись в блоге.

Тем не менее, мы начнем сегодняшнюю запись в блоге с обсуждения фундаментальных различий между классификацией изображений и обнаружением объектов , включая то, может ли сеть, обученная классификации изображений, использоваться для обнаружения объектов (и при каких обстоятельствах).

Как только мы поймем, что такое обнаружение объектов, мы рассмотрим основные компоненты детектора объектов с глубоким обучением, в том числе структуру обнаружения объектов вместе с базовой моделью , два ключевых компонента, которые читатели, плохо знакомые с обнаружением объектов, обычно неправильно понимают .

После этого мы реализуем обнаружение объектов глубокого обучения в реальном времени с помощью OpenCV.

Я также продемонстрирую, как можно игнорировать и фильтровать классы объектов, которые вас не интересуют , без необходимости для изменять сетевую архитектуру или переобучать модель.

Наконец, мы завершим сегодняшнее сообщение в блоге, обсудив, как можно добавить или удалить классы из детектора объектов глубокого обучения , включая рекомендуемые мной ресурсы, которые помогут вам начать работу.

Давайте продолжим и погрузимся в обнаружение объектов глубокого обучения!

Разница между классификацией изображений и обнаружением объектов

Рисунок 1: Разница между классификацией ( слева, ) и обнаружением объектов ( справа, ) интуитивно понятна и проста. Для классификации изображений все изображение классифицируется с помощью одной метки . В случае обнаружения объекта наша нейронная сеть локализует (потенциально несколько) объектов внутри изображения.

Для классификации изображений все изображение классифицируется с помощью одной метки . В случае обнаружения объекта наша нейронная сеть локализует (потенциально несколько) объектов внутри изображения.При выполнении стандартной классификации изображений , учитывая входное изображение, мы представляем его нашей нейронной сети и получаем метку единственного класса и, возможно, вероятность, также связанную с меткой класса.

Эта метка класса предназначена для характеристики содержимого всего изображения или, по крайней мере, наиболее доминирующего видимого содержимого изображения.

Например, учитывая входное изображение на рис. 1 выше ( слева, ), наша CNN пометила изображение как «бигль» .

Таким образом, мы можем думать о классификации изображений как:

- Одно изображение на

- и метка одного класса

Обнаружение объектов , независимо от того, выполняется ли это с помощью глубокого обучения или других методов компьютерного зрения, основывается на классификации изображений и пытается локализовать именно там, где на изображении появляется каждый объект.

При обнаружении объекта по входному изображению мы хотим получить:

- Список ограничивающих рамок или (x, y) -координат для каждого объекта на изображении

- Метка класса , связанная с каждой ограничивающей рамкой

- Оценка вероятности / достоверности , связанная с каждой ограничивающей рамкой и меткой класса

Рисунок 1 ( справа ) демонстрирует пример выполнения обнаружения объектов глубокого обучения.Обратите внимание, как и человек, и собака локализованы с предсказанными ограничивающими рамками и метками классов.

Следовательно, обнаружение объектов позволяет нам:

- Отправить одно изображение в сеть

- и получают несколько ограничивающих рамок и меток классов

Можно ли использовать классификатор изображений с глубоким обучением для обнаружения объектов?

Рисунок 2: Непрерывный детектор объектов глубокого обучения использует подход «скользящее окно» ( слева, ) + пирамида изображений ( справа, ) в сочетании с классификацией.Хорошо, теперь вы понимаете фундаментальную разницу между классификацией изображений и обнаружением объектов :

- При выполнении классификации изображений мы представляем одно входное изображение в сеть и получаем одну метку класса.

- Но при выполнении обнаружения объекта мы можем представить одно входное изображение и получить несколько ограничивающих рамок и меток классов.

Это мотивирует вопрос:

Можем ли мы взять сеть, уже обученную классификации, и использовать ее для обнаружения объектов?

Ответ немного сложен, поскольку технически это «Да» , но по не столь очевидным причинам.

Решения включают:

- Применение стандартных методов обнаружения объектов на основе компьютерного зрения (то есть методов без глубокого обучения), таких как скользящих окон и пирамид изображений - этот метод обычно используется в ваших детекторах объектов на основе HOG + Linear SVM.

- Взятие предварительно обученной сети и , использующее ее в качестве базовой сети в структуре обнаружения объектов глубокого обучения (например, Faster R-CNN, SSD, YOLO).

Метод № 1. Традиционный конвейер обнаружения объектов

Первый метод - это , а не , чистый сквозной детектор объектов глубокого обучения.

Вместо этого мы используем:

- Раздвижные окна фиксированного размера , которые скользят слева направо и сверху вниз для локализации объектов в разных местах

- Пирамида изображений для обнаружения объектов разного масштаба

- Классификация с помощью предварительно обученной (классификационной) сверточной нейронной сети

На каждой остановке пирамиды скользящего окна + изображения мы извлекаем ROI, вводим ее в CNN и получаем выходную классификацию для ROI.

Если вероятность классификации метки L выше некоторого порогового значения T , мы помечаем ограничивающую рамку ROI как метку ( L ). Повторяя этот процесс для каждой остановки скользящего окна и пирамиды изображений, мы получаем выходные детекторы объектов. Наконец, мы применяем подавление не максимальных значений к ограничивающим прямоугольникам, что дает наши окончательные выходные обнаружения:

Рисунок 3: Применение подавления не максимальных значений подавит перекрывающиеся, менее надежные ограничивающие рамки.Этот метод может работать в некоторых конкретных случаях использования, но в целом он медленный, утомительный и немного подвержен ошибкам.

Однако стоит научиться применять этот метод, поскольку он может превратить произвольную сеть классификации изображений в детектор объектов, избегая необходимости явно обучать детектор объектов сквозного глубокого обучения. Этот метод может сэкономить массу времени и усилий в зависимости от вашего варианта использования.

Если вас интересует этот метод обнаружения объектов и вы хотите узнать больше о подходе к обнаружению объектов «скользящее окно + пирамида изображений + классификация изображений», см. Мою книгу Deep Learning for Computer Vision with Python .

Метод № 2: Базовая сеть инфраструктуры обнаружения объектов

Второй метод обнаружения объектов глубокого обучения позволяет рассматривать вашу предварительно обученную классификационную сеть как базовую сеть в среде обнаружения объектов глубокого обучения (например, Faster R-CNN, SSD или YOLO).

Преимущество здесь в том, что вы можете создать полный детектор объектов на основе сквозного глубокого обучения.

Обратной стороной является то, что для этого требуется немного глубоких знаний о том, как работают детекторы объектов глубокого обучения - мы обсудим это подробнее в следующем разделе.

Компоненты детектора объектов глубокого обучения

Рис. 4: Базовая сеть VGG16 является компонентом инфраструктуры обнаружения объектов глубокого обучения SSD.Существует многих компонентов, подкомпонентов и подкомпонентов детектора объектов глубокого обучения, но два, на которых мы собираемся сегодня сосредоточиться, - это два, которые большинство читателей, плохо знакомых с обнаружением объектов глубокого обучения, часто путают:

- Среда обнаружения объектов (напр.Быстрее R-CNN, SSD, YOLO).

- Базовая сеть , которая вписывается в структуру обнаружения объектов.

Базовая сеть , с которой вы, вероятно, уже знакомы (вы просто не слышали раньше, чтобы она называлась «базовой сетью»).

Базовые сети - это ваши общие (классификационные) архитектуры CNN, в том числе:

- VGGNet

- ResNet

- MobileNet

- DenseNet

Обычно эти сети предварительно обучены выполнять классификацию для большого набора данных изображений, такого как ImageNet, чтобы изучить богатый набор различающих, различающих фильтров.

Среды обнаружения объектов состоят из множества компонентов и подкомпонентов.

Например, структура Faster R-CNN включает:

- Сеть предложений регионов (RPN)

- Набор анкеров

- Модуль объединения интересующей области (ROI)

- Окончательная сверточная нейронная сеть на основе регионов

При использовании Single Shot Detectors (SSD) у вас есть такие компоненты и подкомпоненты, как:

- MultiBox

- Приоры

- Приоры фиксированные

Имейте в виду, что базовая сеть - это всего лишь один из многих компонентов , которые вписываются в общую структуру обнаружения объектов глубокого обучения - На рисунке 4 в верхней части этого раздела изображена базовая сеть VGG16 внутри инфраструктуры SSD.

Обычно «сетевая операция» выполняется в базовой сети. Данная модификация:

- Делает его полностью сверточным (т.е. принимает произвольные входные размеры).

- Удаляет более глубокие уровни CONV / POOL в базовой сетевой архитектуре и заменяет их серией новых уровней (SSD), новыми модулями (Faster R-CNN) или некоторой их комбинацией.

Термин «сетевая хирургия» - это разговорный способ сказать, что мы удаляем некоторые из исходных слоев базовой сетевой архитектуры и заменяем их новыми уровнями.

Вы, вероятно, видели малобюджетные фильмы ужасов, где убийца, вероятно, вооруженный топором или большим ножом, нападает на свою жертву и бесцеремонно рубит ее.

Сетевая хирургия более точна и требовательна, чем типичный убийца из фильмов ужасов B.

Сетевая хирургия также очень тактична - мы удаляем части сети, которые нам не нужны, и заменяем их новым набором компонентов.

Затем, когда мы перейдем к обучению нашей структуры для выполнения обнаружения объектов, изменяются веса (1) новых слоев / модулей и (2) базовой сети.

Опять же, полный обзор того, как работают различные фреймворки для обнаружения объектов глубокого обучения (включая роль, которую играет базовая сеть), выходит за рамки этого сообщения в блоге.

Если вас интересует полный обзор обнаружения объектов глубокого обучения, включая теорию и реализацию, обратитесь к моей книге Deep Learning for Computer Vision with Python .

Как измерить точность детектора объектов глубокого обучения?

При оценке производительности детектора объектов мы используем метрику оценки, называемую , средняя точность (mAP), которая основана на пересечении по объединению (IoU) для всех классов в нашем наборе данных.

Пересечение над Союзом (IoU)

Рисунок 5: В этом наглядном примере пересечения через Union (IoU) ограничивающий прямоугольник наземной истины ( зеленый, ) можно сравнить с прогнозируемым ограничивающим прямоугольником ( красный ). IoU используется со средней средней точностью (mAP) для оценки точности детектора объектов глубокого обучения. Простое уравнение для расчета IoU показано на справа .Обычно IoU и mAP используются для оценки производительности детекторов HOG + Linear SVM, каскадов Хаара и методов, основанных на глубоком обучении; однако имейте в виду, что фактический алгоритм, используемый для создания предсказанных ограничивающих рамок, не имеет значения.

Любой алгоритм, который предоставляет предсказанные ограничивающие рамки (и, возможно, метки классов) в качестве выходных данных, можно оценить с помощью IoU. Более формально, чтобы применить IoU для оценки детектора произвольных объектов, нам нужно:

- Ограничивающие прямоугольники (то есть помеченные вручную ограничивающие прямоугольники из нашего набора для тестирования, которые указывают, где находится изображение нашего объекта).

- Предсказанные ограничивающие рамки нашей модели.

- Если вы хотите вычислить отзыв наряду с точностью, вам также понадобятся метки класса достоверности и метки предсказанного класса.

На рис. 5 ( слева, ) я включил наглядный пример ограничивающего прямоугольника наземной истины ( зеленый ) по сравнению с предсказанным ограничивающим прямоугольником ( красный ). Вычисление IoU может быть определено уравнением на рисунке , рис. 5, ( справа, ).

Изучив это уравнение, вы увидите, что IoU - это просто отношение.

В числителе мы вычисляем область перекрытия между предсказанной ограничивающей рамкой и ограничивающей рамкой на основе истинного значения.

Знаменатель - это площадь объединения, или, проще говоря, площадь, охватываемая как прогнозируемой ограничивающей рамкой, так и ограничивающей рамкой наземной истины.

Разделение области перекрытия на площадь объединения дает окончательный результат - пересечение над объединением.

Среднее значение средней точности (MAP)

Примечание: Я решил отредактировать этот раздел из его первоначального вида. Я хотел продолжить обсуждение mAP на более высоком уровне и избежать некоторых из более запутанных расчетов воспоминаний, но, как отметили несколько комментаторов, этот раздел был технически некорректным.По этой причине я решил обновить пост.

Поскольку это мягкое введение в обнаружение объектов на основе глубокого обучения, я оставлю объяснение mAP в упрощенном виде, чтобы вы поняли основы.

Читателей и практиков, плохо знакомых с обнаружением объектов, может ввести в заблуждение расчет MAP. Частично это связано с тем, что MAP является более сложной метрикой оценки. Это также определение расчета MAP может даже варьироваться от одной задачи обнаружения объекта к другой (когда я говорю «задача обнаружения объекта», я имею в виду соревнования, такие как COCO, PASCAL VOC и т. Д.).

Вычисление средней точности (AP) для конкретного конвейера обнаружения объектов по сути представляет собой трехэтапный процесс:

- Вычислите точность , которая представляет собой долю истинных положительных результатов.

- Вычислите отзыва , который представляет собой долю истинных положительных результатов от всех возможных положительных результатов.

- Усредните вместе максимальное значение точности на всех уровнях отзыва с шагом с.

Для вычисления точности мы сначала применяем наш алгоритм обнаружения объектов к входному изображению.Затем оценки ограничивающей рамки сортируются в порядке убывания их достоверности.

Мы знаем из априорных знаний (т. Е. Это пример проверки / тестирования и, следовательно, мы знаем общее количество объектов на изображении), что на этом изображении 4 объекта. Мы стремимся определить, сколько «правильных» обнаружений сделала наша сеть. «Правильный» прогноз здесь - это прогноз, при котором минимальное значение IoU равно 0,5 (это значение настраивается в зависимости от задачи, но 0,5 является стандартным значением).

Здесь вычисления начинают немного усложняться. Нам нужно вычислить точность при различных значениях отзыва (также называемых «уровнями отзыва» или «шагами отзыва»).

Например, представим, что мы вычисляем значения точности и запоминания для трех самых популярных прогнозов. Из трех основных прогнозов нашего детектора объектов глубокого обучения мы сделали 2 правильных. Тогда наша точность - это доля истинных положительных результатов: 2/3 = 0,667. Наш отзыв - это доля истинных положительных результатов из всех возможных положительных результатов на изображении: 2/4 = 0.5. Мы повторяем этот процесс (обычно) для прогнозов от 1 до 10. Этот процесс дает список с точностью значений .

Следующим шагом является вычисление среднего для всех ваших значений top- N , отсюда и термин Средняя точность (AP) . Мы перебираем все значения отзыва r , находим максимальную точность p , которую мы можем получить с нашим отзывом > r , а затем вычисляем среднее значение. Теперь у нас есть средняя точность для одного оценочного изображения.

После того, как мы вычислили среднюю точность для всех изображений в нашем наборе тестирования / проверки, мы выполняем еще два вычисления:

- Вычислите среднее значение AP для каждого класса , дав нам карту MAP для каждого отдельного класса (для многих наборов данных / задач вы захотите изучить MAP по классам, чтобы вы могли определить, работает ли ваш детектор объектов глубокого обучения борется с определенным классом)

- Возьмите карты карты для каждого отдельного класса, а затем усредните их вместе, получив окончательную карту карты для набора данных

Опять же, карта MAP более сложна, чем традиционная точность, поэтому не расстраивайтесь, если вы не поймете ее с первого прохода.Это оценочный показатель, который вам нужно изучить несколько раз, прежде чем вы полностью поймете его. Хорошая новость заключается в том, что реализации обнаружения объектов глубокого обучения обрабатывают вычисления MAP за вас.

Обнаружение объектов на основе глубокого обучения с помощью OpenCV

Мы обсуждали глубокое обучение и обнаружение объектов в этом блоге в предыдущих сообщениях; однако давайте рассмотрим фактический исходный код в этом посте для полноты картины.

Наш пример включает детектор одиночного выстрела (каркас) с базовой моделью MobileNet.Модель была обучена пользователем GitHub chuanqi305 на наборе данных «Общие объекты в контексте» (COCO).

Для получения дополнительной информации ознакомьтесь с моим предыдущим постом , где я представил модель chuanqi305 с соответствующей справочной информацией.

Давайте вернемся к первому вопросу Иезекииля в начале этого поста:

- Как мне отфильтровать / игнорировать классы, которые меня не интересуют?

Я отвечу на этот вопрос в следующем примере скрипта.

Но сначала вам нужно подготовить вашу систему:

- Вам потребуется минимум OpenCV 3.3, установленного в вашей виртуальной среде Python (при условии, что вы используете виртуальные среды Python). OpenCV 3.3+ включает модуль DNN, необходимый для запуска следующего кода. Обязательно используйте одно из руководств по установке OpenCV на следующей странице, обращая особое внимание на то, какую версию OpenCV вы загружаете + устанавливаете.

- Вам также следует установить мой пакет imutils.Чтобы установить / обновить imutils в виртуальной среде Python, просто используйте pip:

pip install --upgrade imutils.

Когда будете готовы, создайте новый файл с именем filter_object_detection.py и начнем:

# импортируем необходимые пакеты из imutils.video импорт VideoStream из imutils.video импорт FPS импортировать numpy как np import argparse импорт imutils время импорта импорт cv2

На строках 2-8 мы импортируем наши необходимые пакеты и модули, в частности imutils и OpenCV.Мы будем использовать мой класс VideoStream для обработки захвата кадров с веб-камеры.

Мы вооружены необходимыми инструментами, поэтому давайте продолжим анализ аргументов командной строки:

# построить аргумент, синтаксический анализ и анализ аргументов

ap = argparse.ArgumentParser ()

ap.add_argument ("- p", "--prototxt", required = True,

help = "путь к файлу прототипа Caffe 'deploy'")

ap.add_argument ("- m", "--model", required = True,

help = "путь к предварительно обученной модели Caffe")

ap.add_argument ("- c", "--confidence", type = float, по умолчанию = 0.2,

help = "минимальная вероятность отфильтровать слабые обнаружения")

args = vars (ap.parse_args ())

Нашему сценарию требуются два аргумента командной строки во время выполнения:

-

--prototxt: путь к файлу prototxt Caffe, который определяет определение модели. -

--model: Наша модель CNN взвешивает путь к файлу.

При желании вы можете указать --confidence , порог для фильтрации слабых обнаружений.

Наша модель может предсказать 21 класс объектов:

# инициализировать список меток классов MobileNet SSD был обучен # обнаружить, затем сгенерировать набор цветов ограничивающей рамки для каждого класса CLASSES = [«фон», «самолет», «велосипед», «птица», «лодка», «бутылка», «автобус», «машина», «кошка», «стул», «корова», «обеденный стол», «собака», «лошадь», «мотоцикл», «человек», «растение в горшке», «овца», «диван», «поезд», «твмонитор»]

Список CLASSES содержит все метки классов, которым была обучена сеть (т.е. Этикетки COCO).

Распространенное заблуждение относительно списка CLASSES состоит в том, что вы можете:

- Добавить новую метку класса в список

- Или удалить метку класса из списка

… и пусть сеть автоматически «знает», что вы пытаетесь выполнить.

Это не так.

Вы, , не можете просто изменить список текстовых меток и заставить сеть автоматически изменять себя для изучения, добавления или удаления шаблонов данных, на которых она никогда не обучалась. Нейронные сети работают не так.

Тем не менее, есть быстрый прием , который вы можете использовать для фильтрации и игнорирования прогнозов, которые вас не интересуют.

Решение:

- Определите набор

IGNOREметок (т. Е. Список меток классов, на которых обучалась сеть, которые вы хотите фильтровать и игнорировать). - Сделайте прогноз на основе входного изображения / видеокадра.

- Игнорировать любые прогнозы, если метка класса существует в наборе

IGNORE.

Реализованный на Python набор IGNORE выглядит так:

IGNORE = set (["человек"])

Здесь мы будем игнорировать все спрогнозированные объекты с меткой класса "person" (оператор if , используемый для фильтрации, будет рассмотрен позже в этом обзоре кода).

Вы можете легко добавить в набор дополнительные элементы (метки классов из списка CLASSES ), которые будут игнорироваться.

Затем мы сгенерируем случайные цвета ярлыков / блоков, загрузим нашу модель и запустим видеопоток:

ЦВЕТА = np.random.uniform (0, 255, размер = (len (КЛАССЫ), 3))

# загружаем нашу сериализованную модель с диска

print ("[ИНФОРМАЦИЯ] загружает модель ...")

net = cv2.dnn.readNetFromCaffe (args ["prototxt"], args ["модель"])

# инициализировать видеопоток, дать датчику камеры прогреться,

# и инициализировать счетчик FPS

print ("[ИНФОРМАЦИЯ] запускает видеопоток ...")

vs = VideoStream (src = 0) .start ()

time.sleep (2.0)

fps = FPS (). start ()

В строке 27 генерируется случайный массив из ЦВЕТОВ , соответствующих каждому из 21 КЛАССОВ .Мы будем использовать эти цвета позже для демонстрации.

Наша модель Caffe загружается в строку , строка 31, с помощью функции cv2.dnn.readNetFromCaffe , и оба наших обязательных аргумента командной строки передаются в качестве параметров.

Затем мы создаем экземпляр объекта VideoStream как vs и запускаем наш счетчик fps ( строки 36–38 ). 2-секундный режим сна дает нашей камере достаточно времени для разогрева.

На этом этапе мы готовы перебрать входящие кадры с камеры и отправить их через наш детектор объектов CNN:

# перебирать кадры из видеопотока в то время как True: # взять кадр из потокового видеопотока и изменить его размер # иметь максимальную ширину 400 пикселей кадр = vs.читать() frame = imutils.resize (рамка, ширина = 400) # возьмем размеры кадра и преобразуем его в blob (h, w) = frame.shape [: 2] blob = cv2.dnn.blobFromImage (cv2.resize (кадр, (300, 300)), 0,007843, (300, 300), 127,5) # передать BLOB-объект по сети и получить обнаружения и # прогнозов net.setInput (большой двоичный объект) обнаружения = net.forward ()

На Line 44 мы захватываем кадр , а затем изменяем размер , сохраняя соотношение сторон для отображения ( Line 45 ).

Отсюда мы извлекаем высоту и ширину, поскольку эти значения нам понадобятся позже (, строка 48, ).

Строки 48 и 49 генерируют blob из нашего кадра. Чтобы узнать больше о blob и о том, как он создается с помощью функции cv2.dnn.blobFromImage , см. Все подробности в этом предыдущем посте.

Затем мы отправляем этот blob через нашу нейронную сеть для обнаружения объектов ( строки 54 и 55 ).

Пройдемся по детекторам:

# перебрать детекции для i в np.arange (0, Detections.shape [2]): # извлекаем уверенность (т.е. вероятность), связанную с # предсказание уверенность = обнаружения [0, 0, i, 2] # отфильтровываем слабые обнаружения, гарантируя уверенность # больше минимальной достоверности если уверенность> args ["уверенность"]: # извлекаем индекс метки класса из # `обнаружения` idx = int (обнаружения [0, 0, i, 1]) # если метка предсказанного класса находится в наборе классов # мы хотим игнорировать, а затем пропустить обнаружение если КЛАССЫ [idx] в ИГНОРИРОВАНИИ: Продолжить

На строке 58 мы начинаем цикл обнаружений .

Для каждого обнаружения мы извлекаем доверительный интервал (, строка 61, ), а затем сравниваем его с нашим порогом достоверности (, строка 65, ).

В случае, если наша уверенность превосходит минимум (значение по умолчанию 0,2 может быть изменено с помощью необязательного аргумента командной строки), мы будем считать обнаружение положительным и действительным обнаружением и продолжим его обработку.

Сначала мы извлекаем индекс метки класса из обнаружений (, строка 68, ).

Затем, , возвращаясь к первому вопросу Иезекииля , мы можем игнорировать классы в IGNORE , установленном на строках 72 и 73 . Если класс игнорируется, мы просто продолжаем обратно в начало цикла обнаружения (и мы не отображаем ярлыки или поля для этого класса). Это соответствует нашему решению «быстрого взлома».

В противном случае мы обнаружили объект в белом списке, и нам нужно отобразить метку класса и прямоугольник на кадре:

# вычисляем (x, y) -координаты ограничивающего прямоугольника для

# предмет

коробка = обнаружения [0, 0, i, 3: 7] * np.массив ([ш, в, ш, в])

(startX, startY, endX, endY) = box.astype ("int")

# рисуем прогноз на кадре

label = "{}: {: .2f}%". format (КЛАССЫ [idx],

уверенность * 100)

cv2.rectangle (frame, (startX, startY), (endX, endY),

ЦВЕТА [idx], 2)

y = startY - 15, если startY - 15> 15, иначе startY + 15

cv2.putText (кадр, метка, (startX, y),

cv2.FONT_HERSHEY_SIMPLEX, 0.5, ЦВЕТА [idx], 2)

В этом блоке кода мы извлекаем координаты ограничивающего прямоугольника ( строки 77 и 78 ), затем рисуем метку и прямоугольник на кадре ( строки 81-87 ).

Цвет метки + прямоугольника будет одинаковым для каждого уникального класса; объекты одного класса будут иметь одинаковый цвет (т.е. все «лодок» на видео будут иметь одинаковую цветовую метку и коробку).

Наконец, все еще в нашем цикле и , мы покажем нашу тяжелую работу на нашем экране:

# показать выходной кадр

cv2.imshow ("Фрейм", фрейм)

ключ = cv2.waitKey (1) & 0xFF

# если была нажата клавиша `q`, выйти из цикла

если ключ == ord ("q"):

сломать

# обновить счетчик FPS

кадров в секунду.Обновить()

# остановить таймер и отобразить информацию о FPS

fps.stop ()

print ("[ИНФОРМАЦИЯ] прошедшее время: {: .2f}". format (fps.elapsed ()))

print ("[ИНФОРМАЦИЯ] прибл. FPS: {: .2f}". format (fps.fps ()))

# немного почистить

cv2.destroyAllWindows ()

против остановки ()

Мы отображаем кадр и фиксируем нажатия клавиш на строках 90 и 91 .

Если нажата клавиша "q" , мы выходим из цикла (, строки 94 и 95, ).

В противном случае мы продолжаем обновлять наш счетчик fps ( Line 98 ) и продолжаем захват и обработку кадров.

В остальных строках, когда цикл прерывается, мы отображаем метрики время + кадры в секунду и очистку.

Запуск детектора объектов глубокого обучения

Чтобы запустить сегодняшний сценарий, вам нужно будет получить файлы, прокрутив страницу до раздела «Загрузки» ниже.

После извлечения файлов откройте терминал и перейдите к загруженному код + модель. Оттуда выполните следующую команду:

$ python filter_object_detection.py --prototxt MobileNetSSD_deploy.prototxt.txt \ --model MobileNetSSD_deploy.caffemodel [INFO] загрузка модели ... [INFO] запуск видеопотока ... [ИНФОРМАЦИЯ] истекшее время: 24.05 [ИНФОРМАЦИЯ] прибл. Кадров в секунду: 13,18Рисунок 6: Демонстрация обнаружения объектов глубокого обучения в реальном времени с использованием той же модели - в правом видео я программно проигнорировал определенные классы объектов.

На приведенном выше GIF-изображении вы можете видеть на слева , что обнаружен класс «человек» - это связано с тем, что у меня пустой IGNORE .Справа

IGNORE .Хотя наш детектор объектов глубокого обучения все еще технически обнаруживает «человек» класс , наш код постобработки может его отфильтровать.

Возможно, вы столкнулись с ошибкой при запуске детектора объектов глубокого обучения?

Первым шагом по устранению неполадок будет проверка того, что у вас подключена веб-камера.Если проблема не в этом, возможно, вы видели в своем терминале следующее сообщение об ошибке:

$ python filter_object_detection.py использование: filter_object_detection.py [-h] -p PROTOTXT -m МОДЕЛЬ [-c CONFIDENCE] filter_object_detection.py: error: необходимы следующие аргументы: -p / - prototxt, -m / - model

Если вы видите это сообщение, значит, вы не передали программе «аргументы командной строки». Это частая проблема, с которой сталкиваются читатели PyImageSearch, если они не знакомы с Python, argparse и аргументами командной строки .Проверьте ссылку, если у вас возникли проблемы.

Полную версию видео с комментарием:

Как я могу добавлять или удалять классы в детекторе объектов глубокого обучения?

Рисунок 7: Тонкая настройка и передача обучения для детекторов объектов глубокого обучения. Как я упоминал ранее в этом руководстве, вы не можете просто добавить или удалить метки классов из списка CLASSES - сама базовая сеть не изменилась .

Все, что вы сделали, в лучшем случае, - это изменили текстовый файл, в котором перечислены метки классов.

Вместо этого, если вы хотите явно добавить или удалить классы из нейронной сети, вам потребуется либо:

- Поезд с нуля

- Выполните точную настройку

Обучение с нуля обычно занимает много времени и является дорогостоящей операцией, поэтому мы стараемся избегать ее, когда это возможно, но в некоторых случаях это совершенно неизбежно.

Другой вариант - выполнить точную настройку.

Точная настройка - это форма трансферного обучения и процесс:

- Удаление полностью связанного слоя, отвечающего за классификацию / маркировку

- Замена его новым, недавно и случайно инициализированным полносвязным слоем

При желании мы можем изменить и другие слои в сети (включая замораживание весов некоторых слоев и их размораживание во время процесса обучения).

Как именно обучить собственный детектор объектов глубокого обучения (включая тонкую настройку и обучение с нуля) - это сложные темы, выходящие за рамки этого сообщения в блоге, но см. Раздел ниже, который поможет вам начать работу.

Где я могу узнать больше об обнаружении объектов глубокого обучения?

Рисунок 8: Обнаружение объектов глубокого обучения в режиме реального времени для видов транспортных средств спереди и сзади.Как мы уже обсуждали в этом сообщении блога, обнаружение объектов не так просто и понятно, как классификация изображений, детали и сложности которой выходят за рамки этой (уже длинной) записи блога.

Это руководство, безусловно, не будет моим последним руководством по обнаружению объектов глубокого обучения (я, несомненно, напишу больше об обнаружении объектов в будущем), но если вы хотите узнать, как:

- Подготовьте собственные наборы данных изображений для обнаружения объектов

- Точная настройка и обучение собственных детекторов объектов, включая Faster R-CNN и SSD, на ваших собственных наборах данных

- Ознакомьтесь с моими лучшими практиками, методами и процедурами, которые можно использовать при обучении ваших собственных детекторов объектов глубокого обучения

… тогда вам обязательно стоит взглянуть на мою новую книгу по глубокому обучению. Inside Deep Learning for Computer Vision with Python , я пошагово расскажу вам о создании собственных детекторов объектов глубокого обучения.

Не забудьте взглянуть на - и не забудьте взять с собой образцы глав (бесплатно) + оглавление в формате PDF, пока вы там!

Сводка

В сегодняшней записи блога вы были мягко ознакомлены с некоторыми тонкостями, связанными с обнаружением объектов глубокого обучения. Мы начали с обзора фундаментальных различий между классификацией изображений и обнаружением объектов, включая то, как мы можем использовать сеть, обученную классификации изображений для обнаружения объектов.

Затем мы рассмотрели основные компоненты детектора объектов глубокого обучения:

- Каркас

- Базовая модель

Базовая модель обычно представляет собой предварительно обученную (классификационную) сеть, обычно обучаемую на большом наборе данных изображений, таком как ImageNet, для изучения надежного набора различающих фильтров.

Мы также можем обучить базовую сеть с нуля, но обычно это занимает значительно больше времени, чтобы детектор объектов достиг разумной точности.

В большинстве случаев вам следует начинать с предварительно обученной базовой модели, а не пытаться обучать ее с нуля.

Когда мы получили твердое представление о детекторах объектов глубокого обучения, мы реализовали детектор объектов, способный работать в режиме реального времени в OpenCV.

Я также продемонстрировал, как вы можете фильтровать и игнорировать ярлыки классов, которые вас не интересуют.

Наконец, мы узнали, что на самом деле добавить или удалить класс в детекторе объектов глубокого обучения не так просто, как добавить / удалить метку из списка жестко запрограммированных меток классов.

Саму нейронную сеть не волнует, если вы измените список меток классов - вместо этого вам потребуется либо:

- Измените саму сетевую архитектуру, удалив полностью связанный уровень прогнозирования классов и тонкую настройку

- Или обучить фреймворк обнаружения объектов с нуля

Для других проектов по обнаружению объектов глубокого обучения вы начнете с детектора объектов глубокого обучения, предварительно обученного задаче обнаружения объектов, такой как COCO.Затем вы выполняете тонкую настройку модели, чтобы получить собственный детектор.

Обучение сквозного пользовательского детектора объектов глубокого обучения выходит за рамки этого сообщения в блоге, поэтому, если вы заинтересованы в том, чтобы узнать, как обучать собственные детекторы объектов глубокого обучения, обратитесь к моей книге Deep Learning for Компьютерное зрение с Python .

В книгу я включил ряд примеров обнаружения объектов глубокого обучения, включая обучение ваших собственных детекторов объектов:

- Обнаружение дорожных знаков, таких как знаки остановки, знаки пешеходного перехода и т. Д.

- Вместе с автомобилями спереди и сзади

Чтобы узнать больше о моей книге по глубокому обучению, , просто нажмите здесь!

Если вам понравилась сегодняшняя запись в блоге, не забудьте указать свой адрес электронной почты в форме под , чтобы получать уведомления о публикации будущих руководств здесь, на PyImageSearch!

Загрузите исходный код и БЕСПЛАТНОЕ 17-страничное руководство по ресурсам

Введите свой адрес электронной почты ниже, чтобы получить.zip кода и БЕСПЛАТНОЕ 17-страничное руководство по ресурсам по компьютерному зрению, OpenCV и глубокому обучению. Внутри вы найдете мои тщательно отобранные учебники, книги, курсы и библиотеки, которые помогут вам освоить CV и DL!

Как найти клад в Minecraft

В этом руководстве Minecraft объясняется, как найти закопанное сокровище, со скриншотами и пошаговыми инструкциями.

Начиная с Водного обновления, вы увидите затонувшие корабли, карты засыпанных сокровищ и закопанные сокровища.Давайте узнаем, как найти закопанное сокровище в Minecraft.

Подписаться

Шаги по поиску сокровищ

1. Найдите место кораблекрушения

Во-первых, вам нужно найти место кораблекрушения в Minecraft. Кораблекрушение выглядит как руины затонувшего корабля и встречается в биомах океана, реки и пляжа. Кораблекрушения обычно появляются под водой, однако в редких случаях вы можете найти затонувшие корабли на суше в биоме пляжа.

Вот как выглядит кораблекрушение:

2.Ищите сундук с картами

У каждого кораблекрушения может быть до 3-х сундуков, в зависимости от размера кораблекрушения - сундук с картой, сундук с сокровищами и сундук с припасами.

Сундук с картами

Сундук с сокровищами

Сундук с припасами

Чтобы найти закопанное сокровище, вам нужно будет найти сундук с картами в месте кораблекрушения.

Откройте сундук с картами и переместите карту закопанных сокровищ в свой инвентарь.

3.Используйте карту закопанных сокровищ

Затем используйте карту закопанного сокровища, чтобы найти местонахождение закопанного сокровища.

Белая точка показывает ваше местоположение, а также указывает направление, в котором вы смотрите. Красный крестик показывает местонахождение Захороненного сокровища. Двигайтесь к похороненному сокровищу. По мере того, как вы приближаетесь, детали карты заполняются.

4. Найдите кладбище.

Как только белая точка окажется на том же месте, что и красный крестик, вы окажетесь над закопанным сокровищем.

5. Копайте, пока не найдете захороненный сундук

Начните копать, пока не найдете сундук. Это может занять некоторое время, в зависимости от вашей удачи.

Копайте, пока не найдете сундук, который выглядит так:

6. Откройте закопанный сундук

Теперь откройте сундук и переместите закопанное сокровище в свой инвентарь.

Поздравляю, вы только что узнали, как найти клад в Minecraft.

rosreestr.ru, минуя пункт 1)

rosreestr.ru, минуя пункт 1) Это бесплатно.

Это бесплатно.

prototype.map () — JavaScript | MDN

prototype.map () — JavaScript | MDN  Каждый раз

Каждый раз  длина >>> 0;

if (typeof callback! == 'функция') {

выбросить новый TypeError (callback + 'не является функцией');

}

if (arguments.length> 1) {

T = аргументы [1];

}

A = новый массив (len);

k = 0;

while (k

длина >>> 0;

if (typeof callback! == 'функция') {

выбросить новый TypeError (callback + 'не является функцией');

}

if (arguments.length> 1) {

T = аргументы [1];

}

A = новый массив (len);

k = 0;

while (k  prototype.map

let a = map.call ('Hello World', function (x) {

вернуть x.charCodeAt (0)

})

prototype.map

let a = map.call ('Hello World', function (x) {

вернуть x.charCodeAt (0)

})

Map (Число)

['1.1', '2.2e2', '3e300']. Map (Число)

['1.1', '2.2e2', '3e300']. Map (str

Map (Число)

['1.1', '2.2e2', '3e300']. Map (Число)

['1.1', '2.2e2', '3e300']. Map (str  См. "Равенство значений

для -0 и 0 " в браузере совместимость

таблица для деталей.

См. "Равенство значений

для -0 и 0 " в браузере совместимость

таблица для деталей.

Но учтите, что ни один механизм не повторяется. все свойств объекта; различные механизмы каждый

включать различные подмножества свойств. (

Но учтите, что ни один механизм не повторяется. все свойств объекта; различные механизмы каждый

включать различные подмножества свойств. ( Спасибо за это.

Спасибо за это.